Hyper-converged Infrastructureを掲げる、気鋭の仮想化向けアプライアンスメーカ、NutanixのMeetupが開催されたので参加してきました。

とりあえず先にメモったことを。

どんな会社?

・2009年創業

・ビジネス規模300M$

・導入実績日本100例程度

・多くのセグメントで使用されているITインフラの”これまで”と”これから”

Nutanixの技術概要ITインフラの”これまで”と”これから”

これまでのインフラ(FC-SANの場合)

サーバーSANー共有ストレージ

・RAIDグループの設定

・LUN設定

・FCドライバ設定

・ゾーニング

・LUNマッピング

・マルチパスの設定

・フォーマット、マウントこれまでのインフラの抱える問題

・根本的に複雑

・限られたスケーラビリティ

・非効率なサイロ化、分断これからの形 hyper converged infrastructure

・ソフトウェア処理で、仮想化環境のサーバと共有ストレージを単一のHWに統合

・スモールスタート

・拡張しやすい

・とにかくシンプル市場動向(2014年12月)

・いくつかある

・VMware、EMCなど

・全体の52%ほど技術概要

・WEBスケールIT

・GoogleやFBのDC

・超大規模をどうやって運用管理するか?

・故障への対応、スケーラビリティの確保、TCO抑制→価格への追求

・汎用的なHWを使用する

・すべてSWで制御する

・計算処理やデータを分散させる普通のIT環境にも大きなメリット

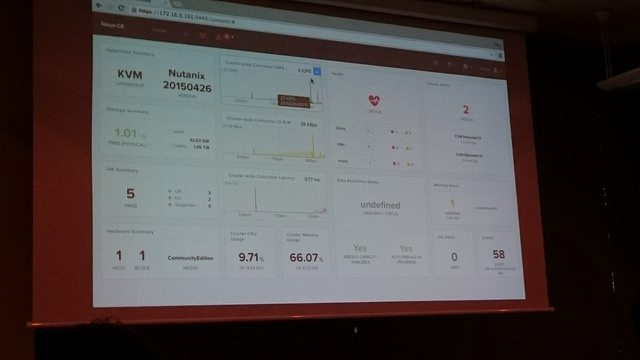

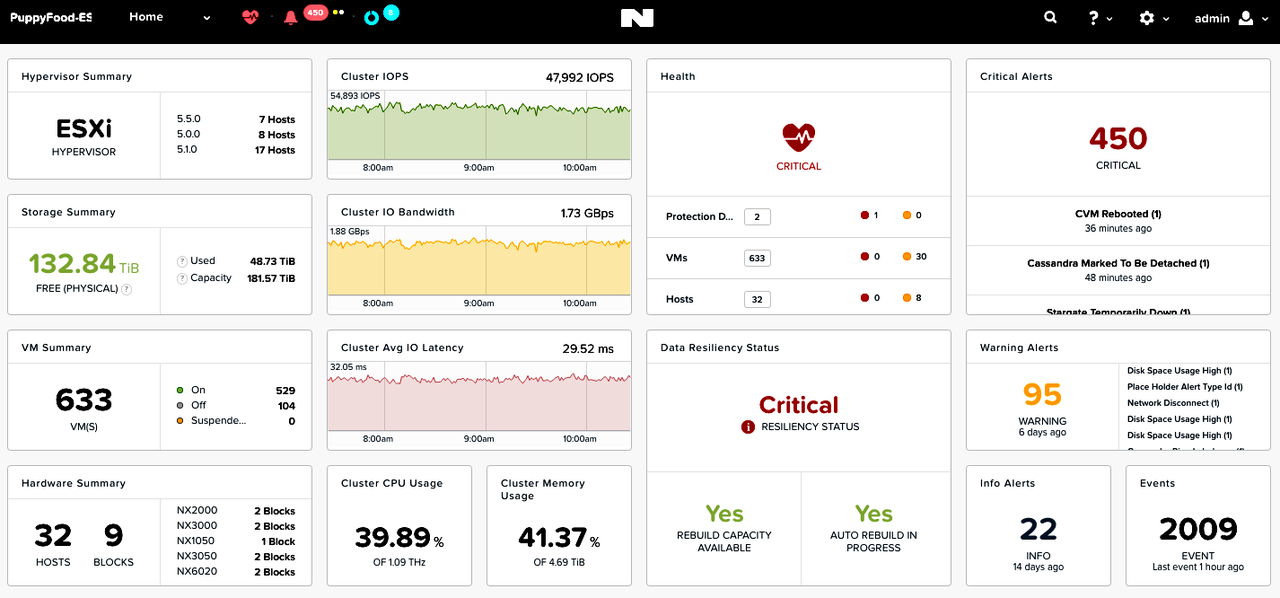

nutanix controller VM

CVM(Controller virtual Machine)

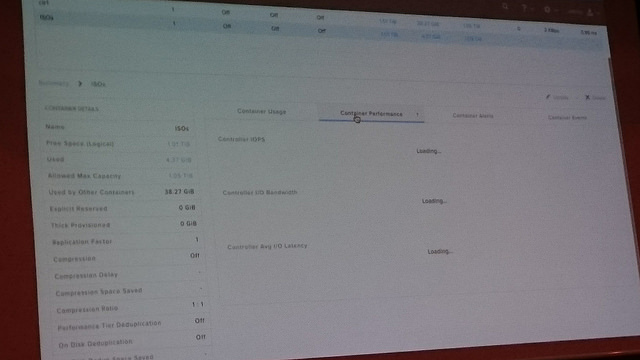

単一のストレージプールに論理統合→NDFS

Hyper Visorには以下のものが使用できる

・KVM、Hyper-V、VMwareController virtual Machine

Nutanixにおける分散ストレージの仕組みにおいて、もっとも重要なコンポーネント

・クラスタのすべてのノード上で動作

・Hypervisorからは、共有ストレージとしてマウント

・ユーザ空間で実行(実装上重要)

・PCI Path-throughでサーバの内蔵ディスクへ直接アクセス

・他ノード上のCVMと互いに通信(監視、データ分散処理)・IOパス

VMがディスクIOを行うと、多くのデータがHVとCVMが接続された内部仮想スイッチをとおて、筐体内で処理される

・CVMはHVの内部仮想スイッチに接続される

・HVは上記で持ったIPアドレスでアクセスマウントする

・各ノード上のCVMは、データのレプリケーションとノード間通信のために外部仮想スイッチに接続され、各部が異なるIPアドレスを保つ高い性能と高可用性

・データは常にローカルのディスクに書き込み

・高可用性のためにほかのノードにもデータを複製

・高IO性能を出すために、複製は複数のノードに分散される読み込み

・基本的にローカルのディスクから

・ライブマイグレーションを行った後など、データがローカルにない場合のみ、他のノードから読み込むノードダウン

・あくまでローカルのディスクにデータを寄せる、が基本

・他ノードとは10GbEで接続されている

ほとんどの顧客ではRF2コピーで足りている(RF3もある)あるノードでCVMのみダウンした場合

・VMはそのノード上で動き続ける

・冗長データパス

・static routeが追記され、パスを確保する

・CVMのアップデート時もこの動作NDFS(Nutanix Distributed File System)

・データの分散、メタデータの管理

・エラー回復、自動リカバリ

・データは市制御、キャッシュ、ティアリング、バランシング

・HV統合用API対応DCのインフラをリニアに拡張

・1ノード単位で拡張可能(最低3ノードから)リファレンスArchitecture

・6Uサイズで1000ユーザを展開

・880デスクトップを6分で起動まとめ

サーバとストレージを統合した仮想化環境向け

優れた管理性、性能、可用性、拡張性Community Edition

日本では今日プレスリリース予定

→実際には6月8日からダウンロード可能の予定

製品

・ソフトウェアにて提供

・BYOハードウェア

・1,3,4ノードの構成

・Replication Factor1、RF2のサポート

・基本、IntelのCPUおよびNICでしか起動しない

→他ので試したら起動もしなかったサポート

・NEXTCommunityへの登録が必要

・100%Communityサポート

・本番環境以外での使用

・Community Edition専用ライセンス

・Communityから製品版へのアップグレードパスはなし

とりあえず構造としてはシンプルに作られているということを強調していました。(分散系はCassandraが使われているそうです)なるべく差分のデータ転送などで済むようにしたりしているので、確かにスモールスタートからノードを増やしていくのも楽そうな構造をしているなというのが感想でした。

その後の懇親会では以下の様な疑問も出てました。

- 大規模なノードになった時、果たしてバックエンドは10GbEで足りるのか?(レイテンシ、そもそもの通信の増大)

- CVMが8vCPUって食い過ぎでは?(実際に使えるリソースの大半が持って行かれているイメージ)

- CVMがGUIがストレージコントローラーの機能を担っているので分かる気もするのですが。

- 形的にはWhitebox Linux?

- 全てをソフトウェアで処理する、と聞かされてイメージしたのがそれでした。

- GUI周りはきっちりと作られているので、自社で専任の監視さんがいないようなところでは導入はいいかもしれない

アプライアンスの価格は分かりませんが、OpenStackほどの環境を用意しなくても良いけど、これからは仮想基盤を用意しないといけないというところには、いいパッケージングなのではないかと思いました。

第2回のMeetupも開催されることが決定しているので、そちらにも参加してみようかと思います。